Современные технологии перевода видео достигли нового уровня реализма благодаря синхронизации губ с помощью нейросетей. Этот процесс, известный как липсинк (lip sync), позволяет создавать переведённые видео, где движения губ идеально соответствуют новой речевой дорожке. 🤖💬

Что такое ИИ-липсинк и как он работает

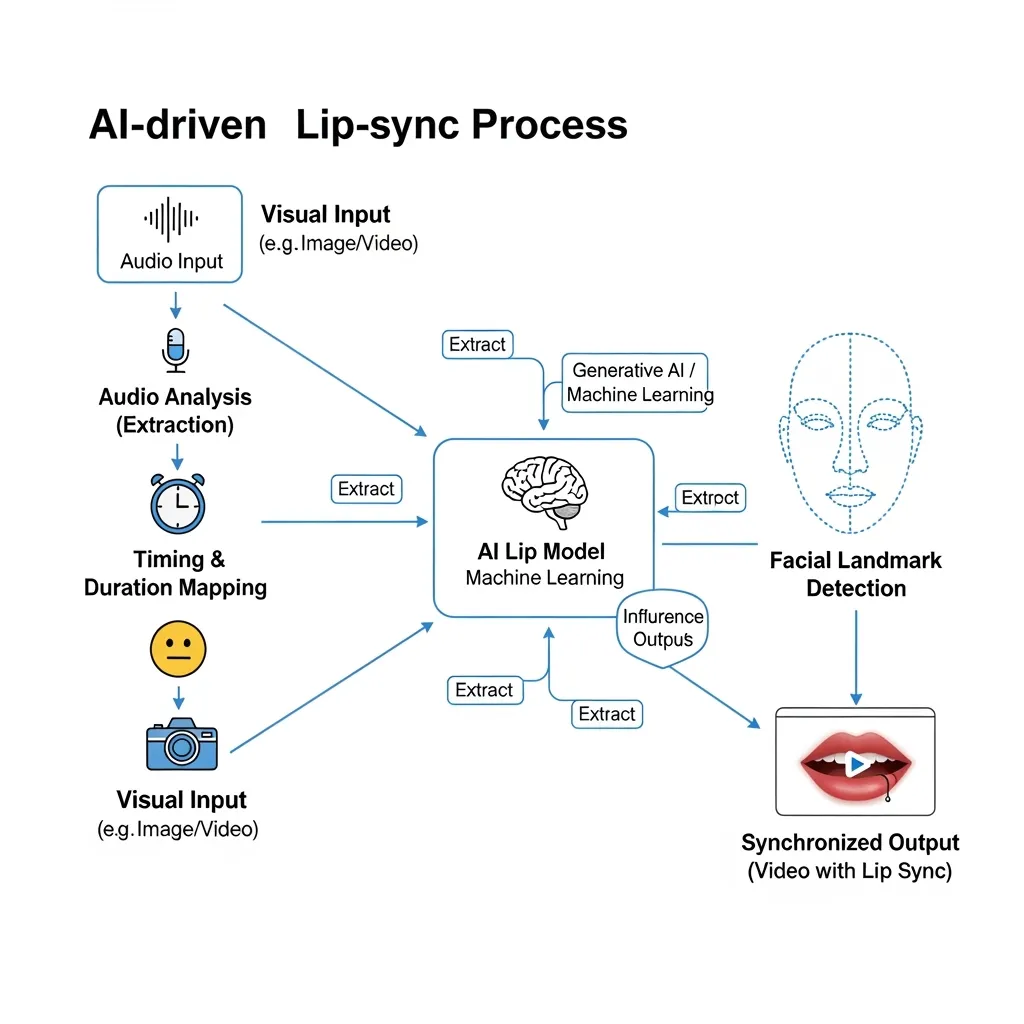

Липсинк с использованием искусственного интеллекта — это технология автоматической синхронизации движений губ на видео с аудиодорожкой путём анализа звукового сигнала и генерации соответствующей мимики лица. В отличие от традиционного дубляжа, где несоответствие артикуляции режет глаз зрителю, ИИ-липсинк создаёт иллюзию того, что человек действительно говорит на новом языке.

Принцип работы технологии

Современные алгоритмы липсинка, такие как Wav2Lip, используют глубокое обучение для анализа связи между аудиосигналом и движениями лица. Процесс включает несколько ключевых этапов:

- Распознавание фонем — нейросеть анализирует звуковую дорожку, выделяя отдельные фонемы и их временные границы. Каждая фонема соответствует определённому положению губ и языка.

- Анализ лица — система определяет ключевые точки лица в видео, включая контуры губ, положение челюсти и другие элементы артикуляционного аппарата.

- Генерация синхронизации — алгоритм создаёт новые кадры видео, где движения губ точно соответствуют фонемам из аудиодорожки, сохраняя при этом естественность мимики.

Без липсинка: заметное несоответствие

С липсинком: естественная синхронизация

Архитектура современных моделей

Базовые принципы нейросетей для липсинка

Большинство современных решений основаны на генеративно-состязательных сетях (GAN) и трансформерах. Модель состоит из нескольких компонентов:

- Энкодер аудио — преобразует звуковой сигнал в признаковое представление

- Энкодер видео — извлекает визуальные особенности лица из исходного видео

- Генератор — создаёт новые кадры с синхронизированными движениями губ

- Дискриминатор — оценивает реалистичность сгенерированных кадров

Обработка временных зависимостей

Ключевая особенность эффективных моделей — учёт временного контекста. Система анализирует не только текущий звук, но и предыдущие/последующие фонемы для создания плавных переходов между позициями губ.

Реальная эффективность в цифрах

Компании, использующие ИИ-липсинк, фиксируют рост завершаемости контента в 10 раз и увеличение аудитории на 200-400%. Платформа Forecast сократила время создания курсов на 50%, а медиакомпания Insider получила 100 млн просмотров за первые недели после локализации. Рынок технологий липсинка вырос до $1,12 млрд в 2024 году с прогнозом $5,76 млрд к 2034, при этом 60% компаний из Fortune 100 уже внедрили эту технологию.

Рекомендации по созданию качественного липсинка

Подготовка исходного материала

Качество видео имеет критическое значение. Для достижения лучших результатов рекомендуется:

Для достижения оптимального качества синхронизации губ при переводе видео используйте AI-дубляж. Узнайте подробнее о технологиях AI-дубляжа →

- Использовать видео с разрешением не менее 720p

- Обеспечить хорошее освещение лица без резких теней

- Выбирать кадры, где лицо повёрнуто прямо к камере

- Избегать чрезмерных движений головы и активной артикуляции губ а также резких поворотов

Оптимальные параметры аудио

Качество синхронизации напрямую зависит от аудиодорожки:

- Чистая речь без фонового шума и музыки

- Единообразный темп произношения

- Чёткая артикуляция — избегайте "проглатывания" звуков

Сравнение популярных решений

| Сервис | Особенности | Ограничения |

|---|---|---|

| Speeek.io | Поддержка 20+ языков, клонирование голоса, обработка видео до 2 часов | Есть бесплатный тариф |

| HeyGen | Поддержка 40+ языков, клонирование голоса | Платная подписка |

| Wav2Lip | Open-source, высокая точность | Требует технических навыков |

| LipDub AI | Профессиональное качество | Высокая стоимость |

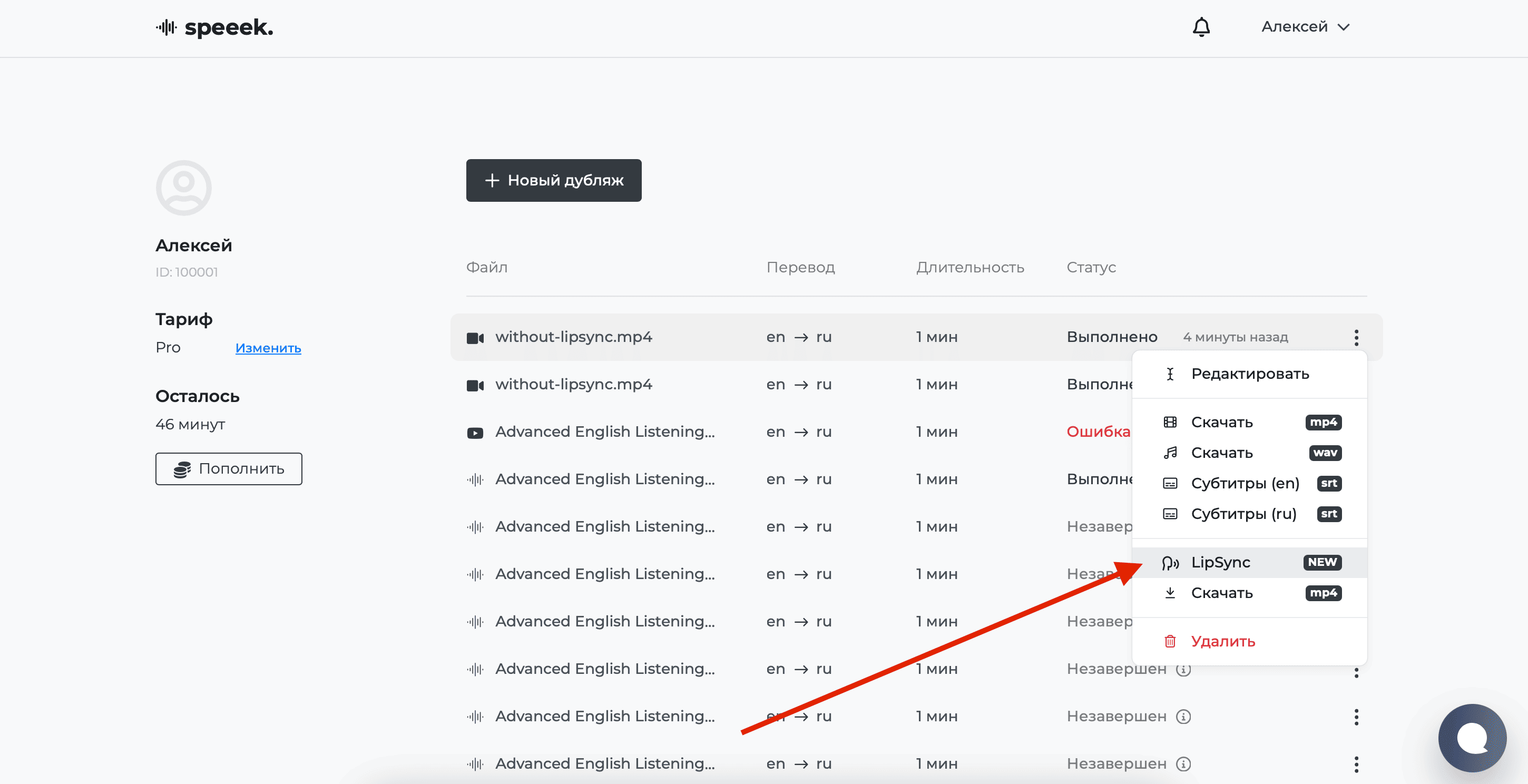

Как создать липсинк на Speeek.io

Наш сервис speeek.io предлагает профессиональный инструмент для создания синхронизированного перевода видео с передовыми алгоритмами липсинка.

Пошаговый процесс:

- Загрузка материала — выберите видеофайл на вашем устройстве или укажите ссылку на видео. Система автоматически определит продолжительность и качество исходника.

- Выбор языка перевода — из доступных 20+ языков выберите целевой язык перевода. Система поддерживает популярные языковые пары, включая русский, английский, испанский, китайский и другие.

- Настройка параметров — определите тип озвучки (мужской/женский голос), количество спикеров и др. На продвинутых тарифах доступны дополнительные параметры качества синхронизации.

- Обработка и генерация — наши серверы выполняют перевод речи, генерацию нового голоса. Процесс обычно занимает 2-5 минут в зависимости от длины видео.

- Финал LipSync — используйте синхронизацию губ как финальный этап работы над переводом после внесения всех правок.

Когда не стоит использовать липсинк

Технические ограничения

Существуют ситуации, когда липсинк может дать неудовлетворительный результат:

Сложная мимика

При ярко выраженных эмоциях система может исказить естественность выражения лица

Нечеловеческие персонажи

Модели плохо работают с анимационными персонажами или животными

Множество говорящих

В кадре с несколькими людьми качество синхронизации снижается

Этические соображения

Важно!

Потенциал для дезинформации — технология может использоваться для создания фейковых новостей и дипфейков. По данным исследования MIT 2024 года, 68% зрителей не могут отличить профессиональный ИИ-липсинк от реального видео.

Согласие участников — при работе с видео реальных людей необходимо получить их согласие на обработку изображения.

Будущее технологии

Развитие ИИ-липсинка продолжается стремительными темпами. Вот какие прорывы ожидаются в ближайшие годы:

Эмоциональный интеллект

Модели научатся точно передавать сложные эмоциональные состояния

Real-time обработка

Задержка синхронизации сократится до 100-200 мс

Полная интеграция

Технология станет стандартом в видеоредакторах и стриминговых платформах

Заключение

Технология липсинка уже сегодня меняет индустрию контента, делая глобализацию видеоматериалов доступной для создателей любого уровня. Понимание принципов работы и ограничений этой технологии поможет эффективно использовать её возможности для достижения ваших творческих и бизнес-целей.